Fragen Sie sich manchmal, warum Dinge so passieren, wie sie es tun? Oder haben Sie sich gefragt, was bestimmte Ergebnisse verursacht und andere nicht? Erklärende Variablen und Antwortvariablen sind Schlüsselkonzepte, um zu verstehen, wie Ereignisse, Prozesse und Verhaltensweisen zu bestimmten Ergebnissen führen. In diesem Artikel werden wir den Unterschied zwischen erklärenden und Antwortvariablen erklären und Beispiele für jede Art geben.

Erklärende Variablen sind solche, die uns helfen zu verstehen, warum etwas passiert ist oder passiert. Es kann als Ursache für eine Wirkung oder ein Ergebnis betrachtet werden. Antwortvariablen sind Faktoren, die das Ergebnis messen, das durch erklärende Variablen verursacht wird. Sie sagen uns, was im Hinblick auf die Eingabe von erklärenden Variablen generiert wurde.

Um mehr Einblick in diese beiden Arten von Variablen zu gewinnen, werfen wir einen Blick auf einige Beispiele, um ihre jeweiligen Rollen weiter zu veranschaulichen. Wir werden auch besprechen, wie diese Konzepte in der Datenanalyse und Forschungsstudien zusammenarbeiten. Durch das Lesen dieses Artikels werden die Leser ein besseres Verständnis von erklärenden und Antwortvariablen gewinnen, damit sie es bei der Analyse ihrer eigenen Datensätze anwenden können!

Was ist eine erklärende Variable?

Wir haben alle schon von den Begriffen „erklärende Variablen“ und „Antwortvariablen“ gehört, aber was bedeutet das wirklich? Lassen Sie uns in dieses faszinierende Konzept eintauchen, um seine Auswirkungen zu verstehen.

Eine erklärende Variable, auch bekannt als Prädiktor oder unabhängige Variable, wird in linearen Beziehungen verwendet, um die Veränderungen in einer anderen Größe namens der Antwort- oder abhängigen Variable zu erklären. Diese Art von Beziehung zwischen zwei Variablen kann in experimentellen Studien beobachtet werden, bei denen eine Variable (die erklärende) konstant gehalten wird, während beobachtet wird, wie sich Änderungen in der anderen (die Antwort) darauf auswirken.

Ein Beispiel könnte sein, verschiedene Konzentrationen von Düngemitteln auf das Pflanzenwachstum zu testen, wobei die Düngemittelkonzentration die erklärende Variable und das Pflanzenwachstum die Antwort ist. Die Kontrollvariablen wären Faktoren wie Bodentyp, Menge an Wasser, die den Pflanzen gegeben wird, usw., die für genaue Ergebnisse konstant bleiben müssen.

Eine einzelne erklärende Variable liefert möglicherweise nicht immer genügend Informationen über ein Ereignis oder Phänomen. Daher werden oft mehrere erklärende Variablen zusammen untersucht, um ihre kombinierte Wirkung auf eine Antwortvariable zu beobachten. Das Verständnis dieser Konzepte wird uns helfen, informierte Entscheidungen auf der Grundlage von datengesteuerten Beweisen zu treffen, die weitreichende Auswirkungen auf unsere Gesellschaft haben können!

Was ist eine Antwortvariable?

Eine Antwortvariable, auch als Outcome-Variable bekannt, ist ein Schlüsselelement eines linearen Regressionsmodells. Es ist der Wert, den wir mithilfe der erklärenden Variablen vorhersagen möchten. Antwortvariablen werden typischerweise auf der y-Achse dargestellt, wenn Regressionslinien und Graphen für lineare Modelle erstellt werden.

Um zu verstehen, was eine Antwortvariable ist und wie sie in ein lineares Regressionsmodell passt, werfen wir einen Blick auf ein Beispiel. Angenommen, es wird eine Studie durchgeführt, die untersucht, ob das Einkommen das Glücksniveau beeinflusst. In diesem Fall würde das Einkommen als erklärende Variable betrachtet, während das Glücksniveau als Antwortvariable angesehen würde, da wir basierend auf unserer Analyse der erklärenden Variablen bestimmen möchten, was das Glücksniveau beeinflusst. Das Ziel besteht dann darin, herauszufinden, wie groß der Einfluss des Einkommens auf das gemeldete Glücksniveau der Menschen ist, indem verschiedene Punkte (Einkommen vs. Glück) auf einem Graphen dargestellt und eine Linie durch sie gezogen wird, um eine Regressionslinie zu erstellen, die uns bei der Vorhersage zukünftiger Datenpunkte helfen kann.

Aus diesem einfachen Beispiel allein können wir sehen, wie wichtig Antwortvariablen beim Aufbau von Vorhersagemodellen wie linearen Regressionen sind – ohne sie wäre es nicht möglich, sinnvolle Schlussfolgerungen aus unseren Daten zu ziehen!

Unterschied zwischen erklärender Variable und Antwortvariable

Erklärende Variablen und Antwortvariablen sind zwei Arten von Variablen, die oft Hand in Hand gehen, wenn statistische Analysen durchgeführt werden. Sie ermöglichen es Forschern, Beziehungen zwischen verschiedenen Faktoren zu beobachten und weitere Erkenntnisse über ein Problem zu gewinnen.

Der Hauptunterschied zwischen erklärenden und Antwortvariablen liegt in der Richtung der Kausalität: Eine erklärende Variable beschreibt, was eine Veränderung verursacht, während eine Antwortvariable zeigt, wie sie von anderen Faktoren beeinflusst wird. Wenn beispielsweise ein lineares Modell untersucht wird, würde die erklärende Variable verwendet werden, um zu erklären, warum bestimmte Werte auf dem Graphen auftreten (d.h. Ursache-Wirkungs-Beziehung). Die Antwortvariable würde hingegen Veränderungen aufgrund von äußeren Einflüssen wie Regressions- oder Korrelationsanalysen messen.

| Variablentyp | Definition | Beispiel |

|---|---|---|

| Erklärende Variable | Eine Variable, die in einem Experiment oder einer Studie manipuliert oder kontrolliert wird, um ihre Auswirkungen auf die Antwortvariable zu bestimmen. | In einer Studie über die Auswirkungen von Bewegung auf den Gewichtsverlust ist die Menge an Bewegung, die durchgeführt wird, die erklärende Variable. |

| Antwortvariable | Eine Variable, die in einem Experiment oder einer Studie beobachtet oder gemessen wird, um die Auswirkungen der erklärenden Variable zu bestimmen. | In einer Studie über die Auswirkungen von Bewegung auf den Gewichtsverlust ist das verlorene Gewicht die Antwortvariable. |

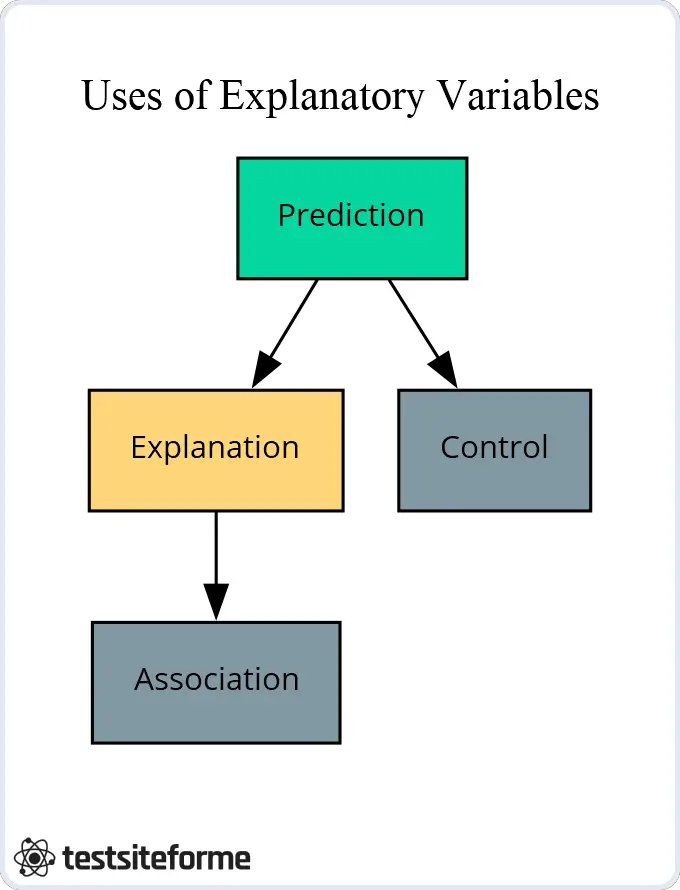

Verwendung von Erklärungsvariablen

Erklärungsvariablen, auch unabhängige Variablen genannt, sind wichtige Bestandteile in der Forschung und Datenanalyse. Sie können verwendet werden, um die Beziehung zwischen zwei oder mehr Ereignissen zu erklären. Um diesen Prozess zu veranschaulichen, stellen Sie sich einen Bauern vor, der verstehen möchte, wie verschiedene Faktoren wie Temperatur und Niederschlag die Ernteerträge beeinflussen. Die Temperatur und der Niederschlag wären seine Erklärungsvariablen – er könnte dann beobachten, welchen Einfluss diese auf die Ernteerträge haben (die Antwort- oder abhängige Variable).

Die Verwendung von Erklärungsvariablen ist ein wesentlicher Bestandteil des Verständnisses der Beziehungen zwischen verschiedenen Phänomenen. Neben traditionellen quantitativen Maßnahmen wie der Temperatur können Forscher kategoriale Variablen verwenden, um Einblicke in Ergebnisse zu gewinnen. Wenn beispielsweise die Auswirkungen von Erziehungsstilen auf das Verhalten von Kindern untersucht werden, können sie kategoriale Bezeichnungen wie „autoritär“ oder „vernachlässigend“ zuweisen, die ihnen helfen, Schlussfolgerungen über die Ergebnisvariable oder abhängige Variable zu ziehen.

Die Erforschung dieser Beziehungen hilft uns, unsere Welt besser zu verstehen und fundierte Entscheidungen auf der Grundlage von Beweisen zu treffen. Durch die Verwendung von Erklärungsvariablen können wir Muster identifizieren, die zuvor verborgen waren – und uns ermöglichen, tiefer als je zuvor in komplexe Themen wie Klimawandel, Krankheitsausbrüche und menschliches Verhalten einzutauchen.

Verwendung von Antwortvariablen

Es lebten einmal zwei sehr unterschiedliche Variablen in der Welt der Datenanalyse – erklärende und Antwortvariablen. Beide waren unerlässlich, um ein gegebenes Phänomen zu verstehen, aber ihre Verwendungen und Funktionen waren sehr unterschiedlich.

Erklärende Variablen werden verwendet, um zu erklären, warum etwas passiert oder wie es ist; sie werden auch als Prädiktorvariablen bezeichnet. Diese können quantitativ oder qualitativ gemessen werden, was es Forschern ermöglicht, zu bestimmen, welche Faktoren einen Einfluss auf das Interessensergebnis haben.

Auf der anderen Seite messen Antwortvariablen die Auswirkungen, die diese Faktoren auf ein bestimmtes Phänomen haben – wie Regressionskoeffizienten in Regressionsmodellen. Diese Art von Variable gibt Einblick darüber, wie sich Änderungen in bestimmten erklärenden Variablen im Laufe der Zeit auf Ergebnisse auswirken.

Während beide Arten von Variablen eine entscheidende Rolle bei der Bestimmung von Beziehungen zwischen verschiedenen Elementen spielen, haben sie unterschiedliche Zwecke: Erklärende Variablen helfen dabei zu interpretieren, warum etwas auftritt, während Antwortvariablen zeigen, welche Art von Auswirkungen diese Erklärungen haben.

Vorteile von erklärenden Variablen

Die Erforschung der Vorteile von erklärenden Variablen eröffnet eine Welt von Möglichkeiten für statistische Studien. Sie sind der Schlüssel zur Entdeckung von Trends und Mustern, die uns helfen, unsere Daten besser zu verstehen. Insbesondere quantitative Variablen bieten erstaunliche Einblicke in die Beziehungen zwischen verschiedenen Elementen in einem Experiment oder einer Studie.

Die Verwendung dieser quantitativen Variablen ermöglicht es Forschern, einen Bestimmungskoeffizienten zu berechnen, der misst, wie gut eine Variable eine andere vorhersagt. Dies hilft, Korrelationen zwischen zwei Datensätzen zu identifizieren, was uns ermöglicht, Hypothesen darüber aufzustellen, warum bestimmte Effekte auftreten und welche Ergebnisse wir von ihnen erwarten können. Darüber hinaus können wir durch die Untersuchung des Korrelationskoeffizienten, der mit jedem Variablenpaar verbunden ist, ein Verständnis dafür gewinnen, wie stark ihre Beziehung ist und ob sie statistisch signifikant ist.

Dieses Wissen bietet uns leistungsstarke Werkzeuge, die es uns ermöglichen, große Datensätze schnell und genau zu analysieren. Es ermöglicht uns auch, Schlussfolgerungen darüber zu ziehen, wie sich Änderungen in einem Faktor auf andere Faktoren in der Gleichung auswirken werden – etwas, das ohne Berücksichtigung der zugrunde liegenden Korrelationsstrukturen in unserem Datensatz unmöglich wäre. Indem wir diese Informationen nutzen, können wir fundiertere Entscheidungen treffen und zuverlässigere Modelle als je zuvor erstellen!

Vorteile von Response-Variablen

Obwohl erklärende Variablen oft verwendet werden, um Beziehungen zwischen verschiedenen Faktoren zu untersuchen, können Response-Variablen auch wichtige Vorteile in Beobachtungsstudien bieten. Während erklärende Variablen die Merkmale einer bestimmten Population und ihre potenziellen Auswirkungen auf Ergebnisse beschreiben, bieten kategoriale Response-Variablen eine direktere Methode zur Messung von Auswirkungen durch kausale Beziehungen.

Response-Variablen ermöglichen es Forschern, zu beobachten, wie Veränderungen in erklärenden Variablen zu spezifischen Ergebnissen innerhalb einer beobachteten Population führen. Dies ist besonders nützlich, wenn versucht wird, die Wirksamkeit von Behandlungen oder Interventionen zu bewerten, die darauf abzielen, das Verhalten bestimmter Individuen zu modifizieren. Im Gegensatz zu den meisten mathematischen Modellen, die Daten aus mehreren Quellen erfordern, ist nur ein Datensatz erforderlich, um den Effekt von Änderungen der erklärenden Variablen mit Response-Variablen zu messen. Dies bietet eine größere Klarheit und Genauigkeit als andere Methoden, da es Wissenschaftlern ermöglicht, direkt zu beurteilen, wie bestimmte Ereignisse bestimmte Ergebnisse beeinflussen.

Beispiele für erklärende Variablen

Lassen Sie uns damit beginnen, den Unterschied zwischen unabhängigen und abhängigen Variablen, auch bekannt als erklärende vs. Antwort, zu betrachten. Eine erklärende Variable (auch Prädiktor oder unabhängige Variable genannt) ist etwas, von dem Sie glauben, dass es das Ergebnis beeinflusst – zum Beispiel Alter, Geschlecht oder Einkommensniveau.

Eine Antwortvariable (auch abhängige Variable genannt) ist etwas, das sich als Reaktion auf die erklärende Variable(n) ändert.

Kontinuierliche Variablen wie Temperatur oder Größe werden oft als erklärende Variablen verwendet; sie repräsentieren Werte auf einer kontinuierlichen numerischen Skala anstelle diskreter Kategorien wie Geschlecht oder Beruf.

Kategoriale Variablen wie Nationalität und religiöse Zugehörigkeit werden manchmal bei der Untersuchung sozialer Phänomene verwendet, da sie nützliche Informationen über die untersuchte Stichprobe liefern.

Schließlich können binäre Variablen wie ‚ja‘ oder ’nein‘, die nur zwei mögliche Werte haben, auch als erklärende Variable dienen, wenn sie für Ihre Forschungsfrage relevant sind.

Beispiele für Antwortvariablen

Man könnte argumentieren, dass Antwortvariablen die schwierigeren der beiden zu erfassenden Variablen sind – diese lästigen Indikatoren für Reaktionszeiten, Überlebenszeiten und individuelle Messungen! Dennoch ist es ein Bereich, der es wert ist, genauer erforscht zu werden, um ein tieferes Verständnis zu erlangen. Antwortvariablen liefern wichtige Informationen über zusätzliche Variationen innerhalb von Datensätzen.

Von wissenschaftlichen Experimenten bis hin zu alltäglichen Beobachtungen finden sich Antwortvariablen überall um uns herum. Sie reichen von physiologischen Reaktionen in der medizinischen Forschung bis hin zum Kaufverhalten von Verbrauchern in Marketingumfragen; sie können auch bei der Messung von Testergebnissen oder der Bewertung von Mitarbeiterleistungsbeurteilungen beobachtet werden. Die Möglichkeiten sind vielfältig und abwechslungsreich, was dieses Feld besonders interessant, aber auch herausfordernd macht.

Daher ist es wichtig, Antwortvariablen und ihre einzigartigen Merkmale zu erkennen, um weitere Einblicke in die Analyse zu gewinnen – mit etwas Übung werden Sie bald darin geübt sein, sie zu identifizieren!

Wie man geeignete erklärende Variablen auswählt

Wenn es darum geht, geeignete erklärende Variablen für eine lineare Regressionsanalyse auszuwählen, müssen bestimmte Schritte unternommen werden. Der erste Schritt besteht darin, den Typ des Regressionsmodells – einfache oder multiple lineare Regression – auszuwählen. Einfache lineare Regression erfordert nur eine unabhängige Variable, während multiple lineare Regression zwei oder mehr erfordert. Nachdem entschieden wurde, welches Modell verwendet werden soll, ist der nächste Schritt, relevante Datensätze in Bezug auf die abhängige (Response-) Variable zu identifizieren und zu sammeln.

Der letzte Schritt bei der Auswahl erklärender Variablen besteht darin zu bestimmen, ob irgendwelche Dummy-Variablen in die Analyse einbezogen werden sollten. Dummy-Variablen werden verwendet, wenn kategoriale Informationen in eine Regressionsanalyse einbezogen werden müssen; sie repräsentieren binäre Werte wie Ja/Nein oder Wahr/Falsch. Sobald alle notwendigen Daten gesammelt wurden, können Forscher dann damit beginnen, ihre Ergebnisse unter Verwendung von einfachen oder multiplen linearen Regressionen zu analysieren, je nachdem, was ursprünglich beschlossen wurde.

Indem Forscher diesen Schritten folgen, werden sie geeignete erklärende Variablen für ihren Datensatz ausgewählt haben und können ihre Ergebnisse mit Zuversicht genau analysieren.

TIPP: Bei der Durchführung von Forschung ist es wichtig, sich daran zu erinnern, welche Art von Variable man betrachtet – ob es sich um erklärende oder Response-Variablen handelt -, um sinnvolle Schlussfolgerungen aus den Daten zu ziehen.

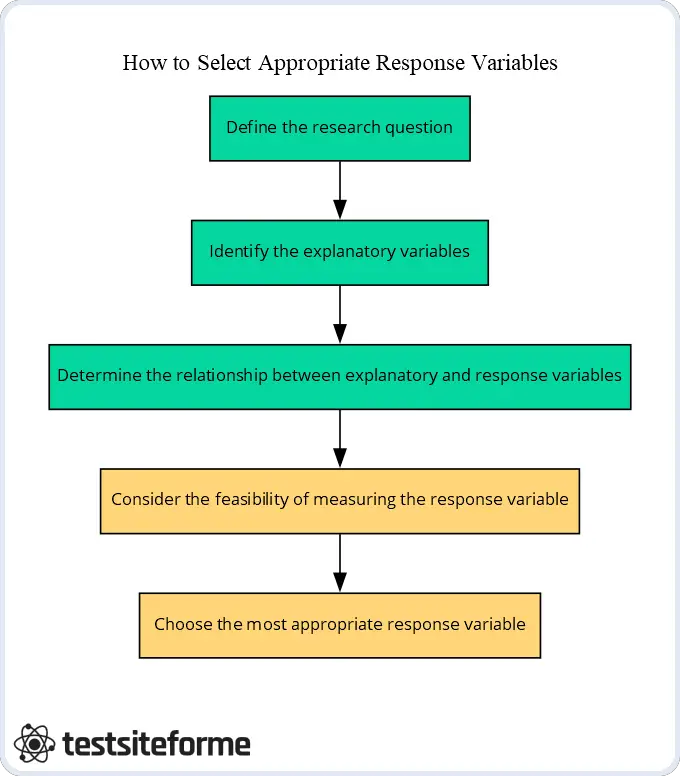

Wie man geeignete Antwortvariablen auswählt

Bei der Erstellung eines Vorhersagemodells ist die Auswahl der Antwortvariable und aller zugehörigen erklärenden Variablen entscheidend für ein genaues Ergebnis. In der einfachen linearen Regression werden beispielsweise eine quantitative Antwortvariable und eine erklärende Variable verwendet. In Mehrfachregressionsmodellen können jedoch mehrere erklärende Variablen vorhanden sein, die sowohl quantitative als auch kategoriale (auch als Indikator-Variablen bezeichnet) Variablen umfassen können.

Die Auswahl geeigneter Antwortvariablen hängt von der gestellten Forschungsfrage und den verfügbaren Daten ab. Im Allgemeinen macht es bei der Verwendung quantitativer Daten Sinn, ein kontinuierliches Ergebnis wie Gehalt oder Gesundheitsergebnisse, die durch numerische Werte gemessen werden, auszuwählen. Bei Verwendung kategorialer Daten kann eine binäre Antwort – wie Ja/Nein-Antworten – gut funktionieren, um sinnvolle Ergebnisse aus der Analyse zu liefern. Es ist auch wichtig zu beachten, dass einige Arten von Antwortvariablen komplexere Methoden erfordern als andere; wenn Sie beispielsweise Veränderungen im Laufe der Zeit messen möchten, kann es erforderlich sein, einen longitudinalen Ansatz in Betracht zu ziehen.

Zu wissen, welche Art von erklärender Variable verwendet werden sollte, kann dazu beitragen, dass die ausgewählte Antwortvariable am besten für Ihre Projektziele geeignet ist. Wenn Sie beispielsweise vorhersagen müssen, ob jemand Produkt A kauft oder nicht, würden Sie wahrscheinlich eine qualitative oder kategoriale erklärende Variable wie Altersgruppe oder Geschlecht verwenden, anstatt eine quantitative wie Preis, da diese Faktoren das Kaufverhalten unterschiedlich beeinflussen können. Letztendlich ist jedoch eine sorgfältige Auswahl sowohl der abhängigen als auch der unabhängigen Variablen vor Beginn jedes Vorhersagemodellierungsprojekts unerlässlich, um erfolgreiche Ergebnisse zu erzielen.

Gängige Missverständnisse im Zusammenhang mit erklärenden Variablen

Wenn es um erklärende Variablen geht, ist es wichtig, gängige Missverständnisse zu verstehen, die damit verbunden sind. Eine Störvariable kann fälschlicherweise als erklärende Variable angesehen werden, da sie oft die Beziehung zwischen zwei anderen Variablen beeinflusst. Zusätzlich können Nebenvariablen als Teil eines Modells betrachtet werden, obwohl sie in Wirklichkeit überhaupt nicht enthalten sein sollten.

Auch Beobachtungsfehler spielen eine Rolle bei der Wahrnehmung erklärender Variablen. Diese Art von Fehler tritt auf, wenn eine Messung den wahren Wert oder Zustand dessen, was beobachtet wird, nicht genau widerspiegelt und stattdessen aufgrund verschiedener Faktoren wie menschlicher Voreingenommenheit verzerrte Ergebnisse liefert. Unerklärliche Variationen können auch dazu führen, dass Menschen falsche Annahmen über einen bestimmten Datensatz und seine zugrunde liegenden Ursachen treffen. Darüber hinaus muss bei der Bestimmung dessen, was eine angemessene Antwortvariable darstellt, eine Auswahlverzerrung vermieden werden, da diese Form der Verzerrung Forscher dazu verleitet, nur diejenigen Fälle auszuwählen, die ihrer Hypothese entsprechen, während sie jegliche gegenteiligen Beweise ignorieren.

Daher ist es unerlässlich, diese potenziellen Probleme zu berücksichtigen, bevor Schlussfolgerungen auf der Interpretation der eigenen Daten gezogen werden. Eine sorgfältige Bewertung und Analyse müssen stattfinden, damit angemessene Entscheidungen darüber getroffen werden können, welche erklärenden Variablen das Verhalten der Antwortvariable(n) am besten erklären.

Gängige Missverständnisse im Zusammenhang mit Response-Variablen

Aus persönlicher Erfahrung verstehen nur etwa 20% der Schüler, die einen Statistik-Kurs besucht haben, den Unterschied zwischen erklärenden und Response-Variablen. Dies ist besorgniserregend, da ein Verständnis dieser Unterscheidung für eine korrekte Interpretation der Ergebnisse von Datenanalyseaufgaben wie Balkendiagrammen, Standardfehlerberechnungen, Konfidenzintervallen und logistischer Regression unerlässlich ist.

Im Allgemeinen sind erklärende Variablen Faktoren, von denen Sie glauben, dass sie eine Veränderung in den Daten beeinflussen oder verursachen könnten – sie erklären, warum etwas passiert ist. Auf der anderen Seite werden Response-Variablen gemessen; sie repräsentieren die Wirkung, die durch Veränderungen in erklärenden Variablen verursacht wird. Ein häufiges Missverständnis besteht darin, dass Response-Variablen immer numerische Werte wie Alter oder Größe darstellen. In Wirklichkeit können diese auch auf kategoriale Ergebnisse wie die Frage, ob jemand bei einem bestimmten Thema mit Ja oder Nein gestimmt hat, verweisen. Darüber hinaus ist es wichtig zu beachten, dass einem Satz von erklärenden Variablen mehrere Antworten zugeordnet sein können.

Es ist leicht zu erkennen, wie verwirrend diese Konzepte sein können, wenn sie nicht sorgfältig betrachtet werden. Mit Übung und Geduld kann jedoch jeder lernen, sie effektiv bei der Analyse von Datensätzen zu verwenden! Das Verständnis ihrer Feinheiten wird alle zukünftigen statistischen Unternehmungen erfolgreicher machen.

Visualisierung von erklärenden und abhängigen Variablen

Sind Sie es leid, sich mit der Visualisierung von erklärenden und abhängigen Variablen herumzuschlagen? Nun, ich bin hier, um Ihnen zu sagen, dass es nicht so schwer sein muss! Sie benötigen kein fortgeschrittenes Mathematikstudium oder ein Verständnis komplexer Modellannahmen, um diese Aufgabe zu bewältigen. Alles, was Sie brauchen, ist ein wenig Wissen über logistische Regression und ordinale Variablen.

Lassen Sie mich zunächst erklären, was diese Begriffe bedeuten:

- Freiheitsgrade beziehen sich darauf, wie viele unabhängige Entscheidungen innerhalb eines Parametersatzes getroffen werden können;

- Modellannahmen beschreiben, welche Algorithmen von Machine-Learning-Modellen zur Vorhersage verwendet werden;

- logistische Regression beinhaltet die Verwendung von Datenpunkten aus verschiedenen Quellen zur Vorhersage von Ergebnissen;

- schließlich ist eine ordinale Variable eine, bei der Sie numerische Werte entlang einer Skala entsprechend der spezifischen Reihenfolge zuweisen können, die sie repräsentieren.

Mit all diesen Informationen sollten Sie nun ein besseres Verständnis dafür haben, wie Sie Ihre erklärenden und abhängigen Variablen visualisieren können.

Jetzt geht es ans Eingemachte! Beginnen Sie damit, einzelne abhängige und erklärende Variablen auf Streudiagrammen gegeneinander zu plotten. Dies ermöglicht es Ihnen, nach Mustern zwischen ihnen zu suchen und Ausreißer zu identifizieren, die die Ergebnisse verzerren könnten. Versuchen Sie dann, lineare oder nichtlineare Regressionen anzuwenden, je nachdem, ob die Beziehung linear erscheint oder nicht – dies gibt Ihnen eine Vorstellung davon, ob es eine statistisch signifikante Korrelation zwischen zwei Variablensätzen gibt. Verwenden Sie schließlich Cross-Validation-Techniken (wie k-Fold), um die Genauigkeit über mehrere Iterationen zu bewerten, bevor Sie den Erfolg erklären!

Conclusion

Zusammenfassend ist es wichtig, die Unterschiede zwischen erklärenden und reaktionsvariablen zu verstehen, um Daten richtig interpretieren zu können. Erklärende Variablen werden verwendet, um ein bestimmtes Ergebnis zu erklären oder vorherzusagen, während Reaktionsvariablen Einblicke in dasselbe Ergebnis bieten. Durch die Kombination dieser beiden Arten von Variablen können Forscher ein besseres Verständnis ihrer Daten erlangen. Es wird geschätzt, dass ein durchschnittlicher Forscher bei der Durchführung von Forschungen über 50 verschiedene erklärende und reaktionsvariablen verwendet.

Es ist auch entscheidend, für jede Studie geeignete erklärende und reaktionsvariablen auszuwählen, da sie die Ergebnisse Ihrer Analyse direkt beeinflussen werden. Eine falsche Interpretation oder ein Missverständnis einer der beiden Variablentypen kann zu falschen Schlussfolgerungen aus den Daten führen, was sich als kostspielig erweisen kann, wenn es nicht frühzeitig korrigiert wird. Die Visualisierung beider Variablentypen kann auch dazu beitragen, weitere Einblicke in die Auswirkungen jeder einzelnen auf die Gesamtergebnisse Ihrer Studie zu gewinnen.

Insgesamt ist die korrekte Nutzung von erklärenden und reaktionsvariablen für eine erfolgreiche Datenanalyse und -interpretation unerlässlich. Sie spielen eine wichtige Rolle bei der Bestimmung, welche Art von Informationen Sie aus Ihren Studien erhalten, daher sollten Sie bei der Auswahl sorgfältig vorgehen und sich immer daran erinnern, Ihre Ergebnisse gegen andere Quellen zu überprüfen, bevor Sie endgültige Entscheidungen auf der Grundlage von ihnen treffen.